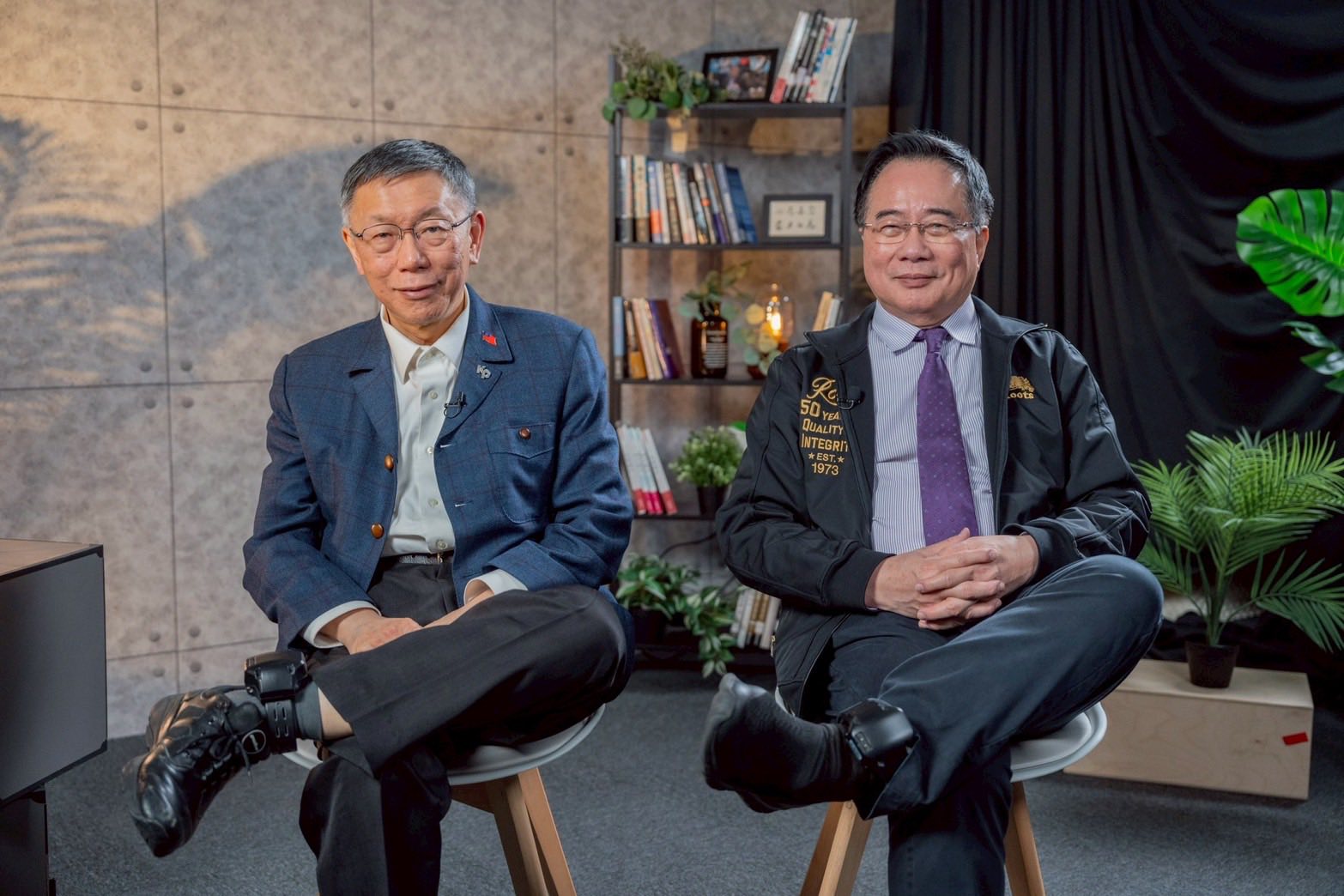

張瑞雄/ 台北商業大學前校長 叡揚資訊顧問

近年來,隨著人工智慧(AI)技術的迅速發展,世界各國對其軍事應用的需求和關注日益增加。特別是中國的軍事研究機構,透過使用Meta公開的AI模型Llama,開發出了一個名為ChatBIT的軍事應用AI工具。這一事件引發了對AI開放性及其軍事應用的深層討論,也揭露了國際社會在AI技術使用上的政策差異和利益競爭。

儘管Meta對Llama的使用設有限制,包括禁止其用於軍事和間諜活動,但開放式AI模型的設計,使得一旦發布,控制其用途變得相當困難。這種情況暴露了開放性AI模型面對不受控制應用時的脆弱性,也給開放程式碼社群帶來了新的挑戰。

AI在軍事領域的使用帶來的潛在風險,也促使國際社會積極制定相關的責任框架和道德準則。美國等國於2023年推出的《負責任軍事AI使用宣言》,便明確指出各國在開發和使用軍事AI時,應遵循國際人道法的原則,並確保在使用過程中有完善的監控和人類決策參與,以防止AI的自動化系統造成無法預見的事故或偏見。宣言同時呼籲各國在軍事AI的整個生命週期中,從設計、測試到部署,皆須採取透明、可審核的措施,以確保其符合道德和法律標準。

這一框架的意義在於提供了一個全球行為的準則,使各國在軍事AI應用中不僅能加強自身的防衛力,也能共同維護國際穩定。但目前的國際局勢卻顯得緊張。美國與中國在AI技術上的競爭日趨白熱化,美國政府已經開始加強對出口至中國的高科技設備進行限制,以防止中國在軍事領域取得優勢。

此時此刻,AI的開放性是否應該保留成為了各界討論的焦點。Meta和其他支持AI開放性的人士認為,開放性有助於加速技術發展和促進創新,並且有助於美國在全球競爭中保持領先地位。但這一觀點也遭到批評,批評者認為,在國際安全的背景下,開放式AI可能帶來極大的安全隱患。例如雖然Meta的AI模型在條款上規定禁止用於軍事用途,但當該模型被開放給全球時,各種違反條款的使用幾乎難以避免,尤其是像中國這樣的科技強國。

針對這種開放AI的利弊,美國政府已經著手於尋求平衡。在2023年10月,拜登總統簽署了一項行政命令,以管理AI的發展,並指出AI的創新雖然帶來巨大好處,但也可能帶來巨大的安全風險。此命令的核心是希望建立一個更具約束力的法律框架,確保AI技術的使用不會威脅到國家安全。

企業在追求開放性和創新速度的同時,也要注意AI對於國家安全的意義。現實的國際局勢凸顯了AI技術應用的潛在風險和對全球穩定的威脅,世界各國正積極追求AI技術的自主發展,不僅在軍事領域加強應用,也在整個產業中推動AI驅動的決策,但前提應該還是AI的安全性。

AI的軍事應用不僅是科技競賽中的一部分,更關乎全球安全穩定和各國之間的信任。國際社會必須積極尋求多邊合作,確保AI在軍事領域的使用符合道德和法律的標準。正如《負責任軍事AI使用宣言》所提倡的,透過確保AI技術在開發、部署和使用過程中的可審核性,才可以在技術進步中平衡國家的安全需求和道德責任。

【張瑞雄專欄】AI的開放和軍事用途風險

中國的軍事研究機構,透過使用Meta公開的AI模型Llama,開發出了一個名為ChatBIT的軍事應用AI工具。圖/由Chat GPT生成